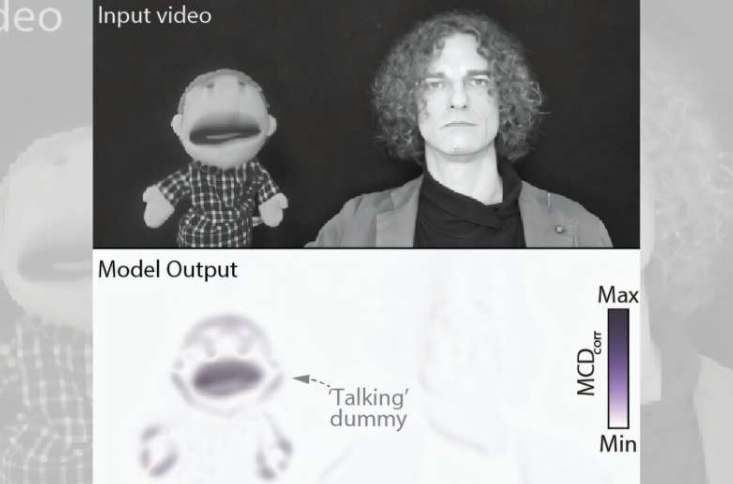

L’Université de Liverpool a développé un nouveau modèle informatique qui fusionne de manière unique la vision et l’audition, simulant les mécanismes de perception humaine. Inspiré par la biologie et basé sur les fonctions du cerveau des insectes, ce modèle a été amélioré par le Dr Cesare Parise, maître de conférences senior en psychologie, et est capable de traiter des signaux visuo-auditifs réels, tels que des vidéos et des sons, plutôt que de dépendre de paramètres abstraits.

Le Dr Parise a souligné que, bien que les recherches sur la perception visuo-auditive durent depuis des décennies, les modèles existants peinent à traiter des signaux visuo-auditifs réels, limitant ainsi leurs applications. Le nouveau modèle repose sur le principe de détection de corrélation et, en simulant un arrangement de détecteurs, a réussi à reproduire les résultats de 69 expériences impliquant des humains, des singes et des rats, devenant ainsi la plus grande simulation dans ce domaine. Ce modèle non seulement correspond au comportement de différentes espèces, mais surpasse également les modèles leaders d’inférence causale bayésienne, et peut prédire les points de regard des humains lors du visionnage de films visuo-auditifs, servant de modèle de saillance léger.

« L’évolution a résolu le problème de coordination entre le son et la vision par un calcul simple et universel, extensible à travers les espèces et les environnements. » a souligné le Dr Parise. Le nouveau modèle traite directement les signaux visuo-auditifs bruts, applicable à tout matériel du monde réel, avec une portée d’application dépassant la neurosciences. Comparé aux modèles de saillance visuo-auditive existants qui dépendent de vastes réseaux et d’ensembles de données étiquetés massifs pour l’entraînement, ce modèle est léger, efficace et ne nécessite pas d’entraînement, devenant un candidat puissant pour les applications de nouvelle génération. Parise a conclu que le modèle, parti des études sur la vision du mouvement des insectes, explique désormais comment le cerveau intègre le son et la vision, offrant un nouveau blueprint pour la neurosciences et la recherche en intelligence artificielle.