fr.wedoany.com Rapport : Google a lancé une technologie de compression mémoire IA nommée TurboQuant, visant à optimiser l'utilisation de la mémoire pour les grands modèles de langage et les moteurs de recherche vectorielle. Cette technologie peut réduire l'empreinte mémoire d'environ 6 fois, tout en augmentant la vitesse de calcul de l'attention jusqu'à 8 fois, sans perte de précision du modèle. TurboQuant devrait être officiellement présenté plus tard ce mois-ci lors de la conférence ICLR 2026 qui se tiendra à Rio de Janeiro, au Brésil.

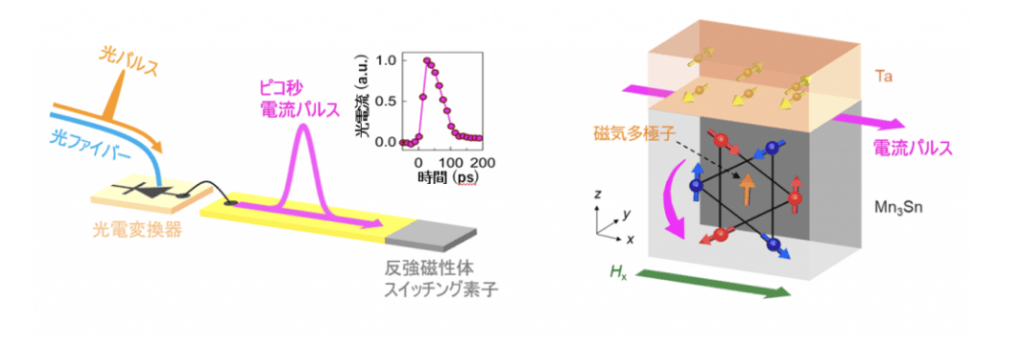

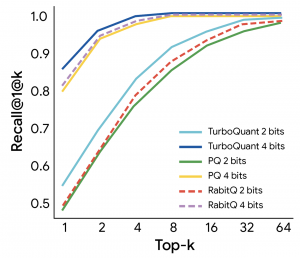

TurboQuant combine deux technologies complémentaires : PolarQuant et l'algorithme QJL. PolarQuant simplifie la structure géométrique des vecteurs de données par rotation aléatoire, permettant une compression de haute qualité ; QJL utilise quant à lui une capacité de compression résiduelle d'environ 1 bit pour éliminer les biais, garantissant ainsi l'exactitude des scores d'attention. Google a déclaré dans son blog : « Cet algorithme crée essentiellement une sténographie à grande vitesse, sans surcharge mémoire. »

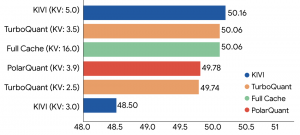

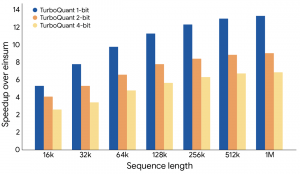

Lors de plusieurs tests de référence, tels que ZeroSCROLLS et Needle in a Haystack, TurboQuant a significativement réduit l'utilisation de la mémoire tout en maintenant une haute précision. Les tests ont montré qu'il pouvait comprimer la précision du cache de 16 bits à environ 3 bits, atteindre une accélération de 8 fois sur les GPU H100, et améliorer le taux de rappel dans la recherche vectorielle.

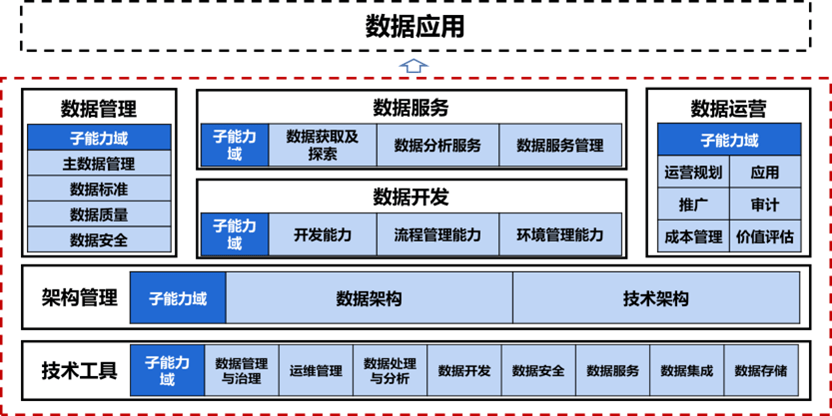

TurboQuant optimise non seulement l'efficacité de compression, mais atténue également les limitations de la bande passante mémoire, ouvrant de nouvelles voies pour l'extension des systèmes d'IA. Alors que la taille des modèles augmente, cette technologie qui réduit les besoins en mémoire sans affecter la précision pourrait devenir un facteur clé pour faire progresser le développement de l'IA.

Texte compilé par Wedoany. Toute citation par IA doit mentionner la source « Wedoany ». En cas de contrefaçon ou d'autre problème, veuillez nous en informer rapidement ; nous modifierons ou supprimerons le contenu le cas échéant. Courriel : news@wedoany.com